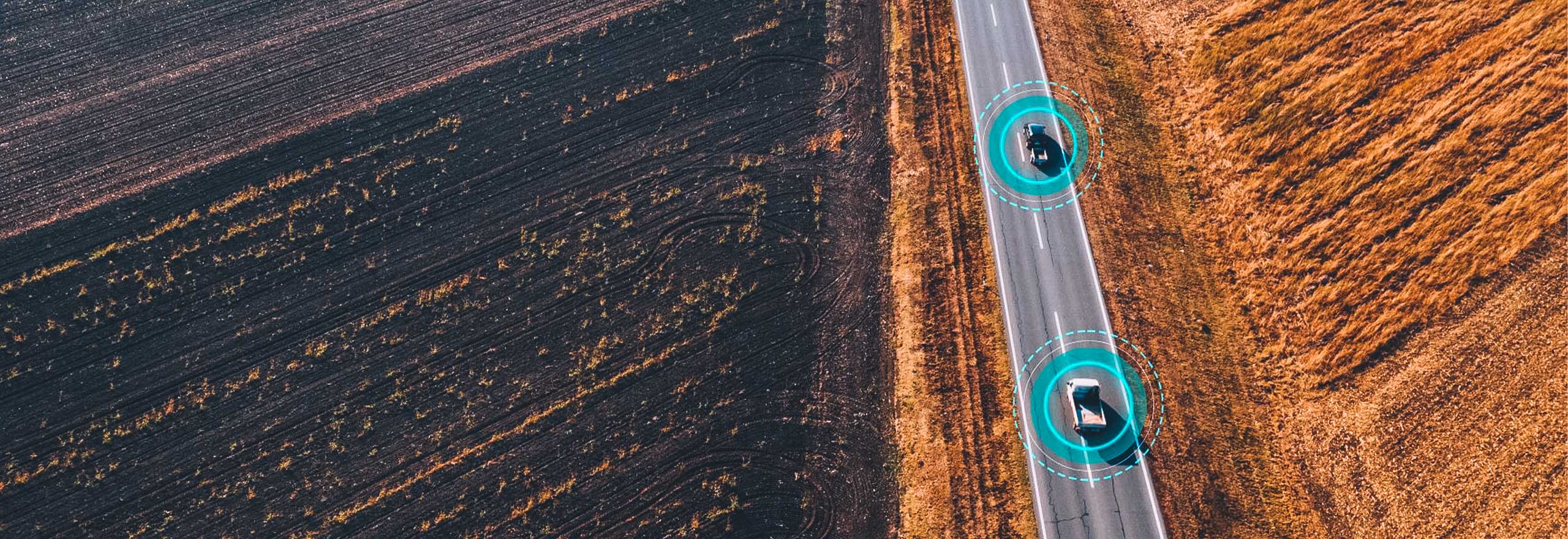

Sensorfusion für Positionierungslösungen

Autonomie durch Sensorfusion ermöglichen.

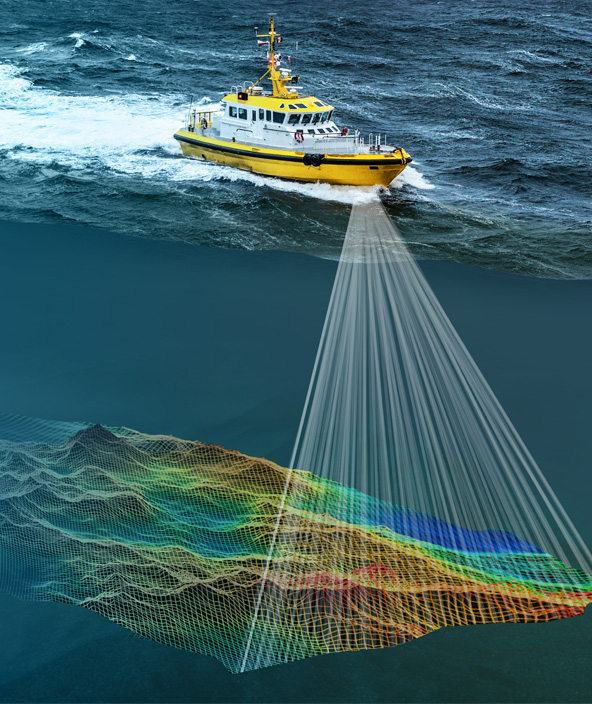

Bei der Sensorfusion geht es im Grunde genommen darum, verschiedene Sensormessungen miteinander zu kombinieren, sei es GNSS, Trägheit, Fotogrammetrie, LiDAR/RADAR oder andere.

Wir erklären, wie dies erreicht wird und wie autonome Anwendungen ermöglicht werden.

Übersicht

Warum Sensorfusion?

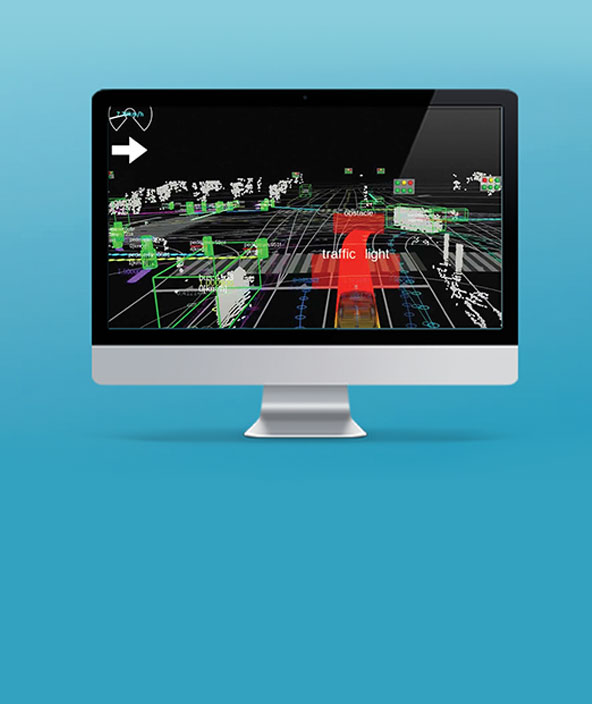

Die Sensorfusion umfasst den komplizierten Prozess der Verwendung von Algorithmen, um Messungen von vielen verschiedenen Sensoren zusammenzuführen. Das Ergebnis ist eine hochpräzise, zuverlässigere und sicherere Ausgangsposition, die wir in autonomen Anwendungen verwenden können.

Beispielsweise bestimmen globale Navigationssatellitensysteme (GNSS) wie GPS-Koordinaten, wo wir uns auf der Welt befinden. Trägheitsmessungen bestimmen unsere Ausrichtung in der Welt – unsere Richtung, Lage, Geschwindigkeit und mehr. Wahrnehmungssensoren wie Fotogrammetrie, Kameras, LiDAR und RADAR identifizieren Objekte oder Gefahren in der Nähe, einschließlich Verkehrszeichen, Fußgänger oder Gegenstände, mit denen interagiert werden soll.

Wie ermöglicht Sensorfusion Autonomie?

Ein autonomes System basiert auf Sensorfusion, um zu verstehen, wo es sich auf der Welt befindet, welche Gefahren es gibt, wie es mit welchen Objekten interagieren soll und vieles mehr. Ohne Sensorfusionsalgorithmen und die Wahrnehmungs- oder Positionierungstechnologien, die Daten liefern, wären autonome Anwendungen nicht möglich.